Chequeado en la EMNLP 2017, una conferencia para enseñarle a las computadoras a entender a los humanos

En Chequeado estamos desarrollando tecnologías que nos permitan entender ciertas características del lenguaje natural (con especial foco en el idioma español) para avanzar hacia la automatización de parte del proceso de fact-checking. El mes pasado se realizó la conferencia EMNLP (metodologías empíricas para el procesamiento del lenguaje natural) en Copenhagen, Dinamarca, y esto es lo más interesante que vimos allí.

La EMNLP es una conferencia con un enfoque más cercano a la academia que a la industria, donde se presentan los últimos avances de NLP (procesamiento del lenguaje natural, según su sigla en inglés) a través de una serie de tutoriales, workshops y charlas.

Desde Chequeado participamos de esta conferencia y queremos en este post compartir algunos aprendizajes y resumir tres tendencias que consideramos clave para quienes enfrentan desafíos similares a los nuestros.

Tendencias

1- Word Embeddings

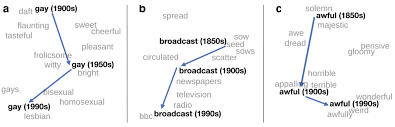

Es una tecnología que interpreta a cada palabra en función de las palabras que aparecen en su contexto. Lo que esto permite es analizar la similitud de diferentes fragmentos de texto (palabras, oraciones, párrafos). Es decir, la palabra “dinero” suele ser mencionada junto con “banco” o “economía” al igual que la palabra “plata”, por lo tanto las palabras “dinero” y “plata” son parecidas.

Esto es muy útil para los procesos de automatización porque permite saber con cierta precisión que, por ejemplo, las frases “la inflación de 2015 fue de 22%” y “el aumento de precios de 2015 fue de 22%” hablan de temas muy similares.

2 – Argument Mining (minería de argumentos)

Se trata de una rama de NLP dedicada a analizar las discusiones en diferentes ámbitos, tratando de entender las características lingüísticas de los argumentos que prevalecen.

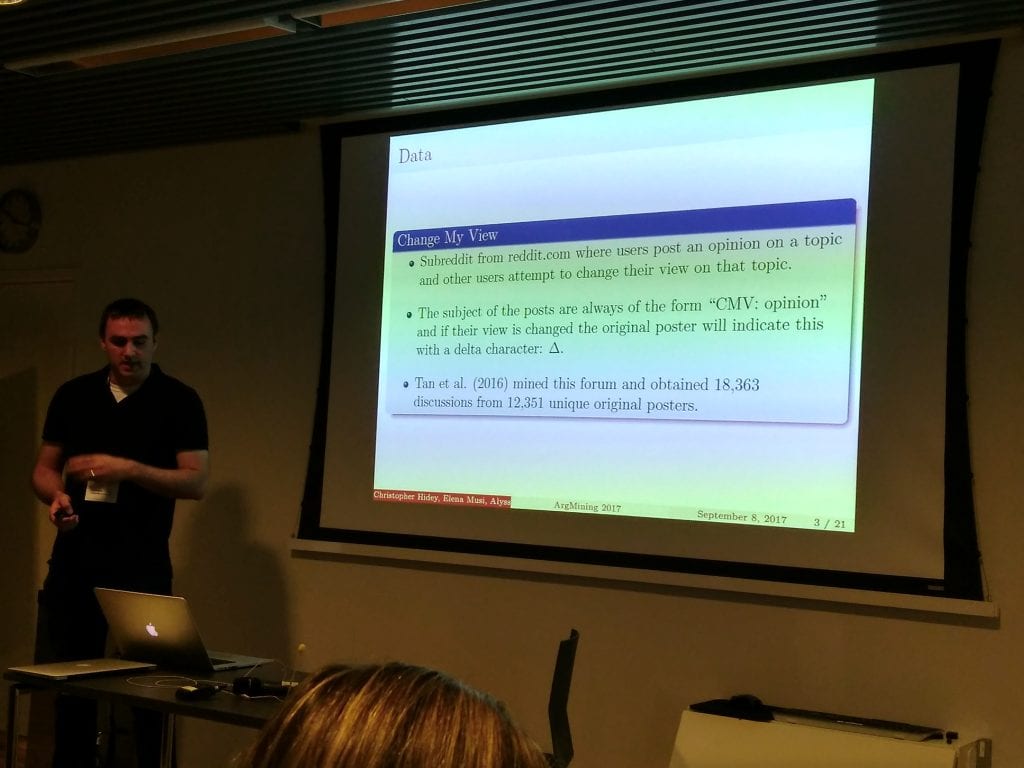

Uno de los hallazgos que nos gustaría destacar es un paper presentado por Christopher Hidey de la Universidad de Columbia, Estados Unidos. El trabajo consistió en clasificar una gran cantidad de posts de la red social Reddit de la categoría “Change My View”, donde el usuario que crea un hilo enuncia por qué está a favor o en contra de cierto tema y luego otros usuarios tratan de cambiar su opinión al respecto. Se clasificaron los argumentos en emocionales, fácticos y referenciales para luego saber qué tipo de argumento o qué combinación de ellos fue la más efectiva a la hora de convencer a un usuario de cambiar su opinión.

En Chequeado, donde tenemos como misión mejorar la calidad del debate público, estamos interesados en este enfoque, ya que creemos que nos puede ayudar a mejorar el impacto que tienen nuestros chequeos e investigaciones en la comunidad.

3 – Natural language generation (generación de lenguaje natural)

Esta rama estudia cómo generar texto de forma automática a partir de un conjunto de bases de datos que contienen información de diferentes hechos y eventos. En el mundo de los medios ya se está usando para escribir notas sobre temas muy específicos, relevantes para nichos muy reducidos.

Esta tecnología, prevemos, le podría permitir a Chequeado escribir automáticamente borradores iniciales de notas, para que luego sean revisadas por un editor (humano). Una alternativa interesante sería la de generar notas basadas en bases de datos que el equipo humano de Chequeado no suele cubrir dado que somos en la Redacción menos de una decena, permitiéndonos cubrir más temas o regiones del país y llegar así a aumentar nuestro alcance e impacto.

Brecha idiomática

Uno de los desafíos a la hora de desarrollar este tipo de aplicaciones es que, en este campo, tanto en la academia como en la industria predomina el idioma inglés, por lo que hay menor disponibilidad de bases de datos, aplicaciones, papers y tecnologías que soporten otros idiomas. Dados los avances significativos que observamos en esta conferencia respecto de Machine Translation (traducción automática de un lenguaje a otro), creemos que esta “brecha” en cantidad de recursos entre distintos idiomas va a ser mucho menor en los próximos años. Y eso nos entusiasma.

Una reciente aplicación concreta: chequeos similares a los mencionados en el chequeo en vivo

El evento “Chequeo colectivo en vivo” es un chequeo de un discurso/debate que organizamos desde 2013 desde Chequeado junto con periodistas,expertos y voluntarios en diferentes temáticas. Como el evento es en vivo y realizar el chequeo de una frase toma cierto tiempo, solemos publicar en redes sociales notas previas que se relacionen con lo dicho por el o los líderes.

En este último chequeo en vivo al debate de candidatos a diputados nacionales porteños le sumamos un aliado técnico a la memoria de los periodistas que hasta ahora debían recordar las notas relacionadas con lo que se decía en el debate o discurso.

Tombolini acaba de hablar sobre niñez y pobreza. Te recordamos esta nota: https://t.co/bI1NtznKKV#DebateChequeado

— Chequeado (@Chequeado) 12 de octubre de 2017

El de arriba es uno de los tuits que pudimos tuitear en vivo gracias a la relación que hizo Chequeabot entre lo que se decía en el debate y nuestra base de chequeos.

Armamos una aplicación web utilizando la tecnología word embeddings y por cada frase chequeable que identificamos en el debate porteño, esta aplicación buscaba frases muy similares que habíamos chequeado previamente. Esto nos permitió reaccionar más rápido y ofrecerle al lector contenido relevante en relación con lo que iba sucediendo liberando el tiempo de los periodistas para dedicarse a producir nuevos chequeos.

Comentarios

Valoramos mucho la opinión de nuestra comunidad de lectores y siempre estamos a favor del debate y del intercambio. Por eso es importante para nosotros generar un espacio de respeto y cuidado, por lo que por favor tené en cuenta que no publicaremos comentarios con insultos, agresiones o mensajes de odio, desinformaciones que pudieran resultar peligrosas para otros, información personal, o promoción o venta de productos.

Muchas gracias