Cómo identificar videos creados con inteligencia artificial durante las elecciones

- En la previa a las elecciones legislativas en la Ciudad de Buenos Aires, se difundieron videos falsos de Mauricio Macri y Silvia Lospennato generados con inteligencia artificial (IA).

- Un informe de la Universidad de Stanford (EE.UU.) advierte que la creación y difusión de videos hechos con IA ya afecta procesos electorales en todo el mundo.

- Expertos recomiendan revisar detalles faciales, buscar fuentes originales y consultar las cuentas oficiales para evitar caer en este tipo de desinformaciones.

El domingo 18 de mayo se realizaron las elecciones legislativas en la Ciudad de Buenos Aires (CABA), que dieron como ganador al candidato de La Libertad Avanza, Manuel Adorni, con el 30,1% de los votos.

En plena veda electoral, se viralizaron 2 videos, donde supuestamente el líder del PRO, Mauricio Macri, y la candidata a legisladora por ese partido, Silvia Lospennato, anunciaban la baja de su candidatura para apoyar a Manuel Adorni, candidato de La Libertad Avanza. Sin embargo, ambos contenidos habían sido generados con inteligencia artificial (IA).

Este 24 de junio el diputado nacional por Córdoba Rodrigo De Loredo (UCR) viralizó un video del gobernador de la provincia, Martín Llaryora (PJ), hecho con inteligencia artificial con la voz e imagen del gobernador, pronunciando un discurso que no existió en la realidad.

La desinformación suele ser protagonista durante las elecciones y la difusión de videos realizados con IA -como los “deepfakes”– ya es un fenómeno global. Por eso, en tiempos de carrera electoral es necesario estar atento a los posibles contenidos falsos que puedan circular para evitar caer en engaños.

Videos hechos con IA para desinformar en tiempos electorales, un fenómeno global

La difusión de videos generados con IA en contextos electorales no sólo ocurre en la Argentina, sino que se trata de un fenómeno global. De hecho, AI Index 2024, un informe de la Universidad de Stanford (Estados Unidos), advirtió que los “deepfakes políticos ya están afectando los procesos electorales en todo el mundo”.

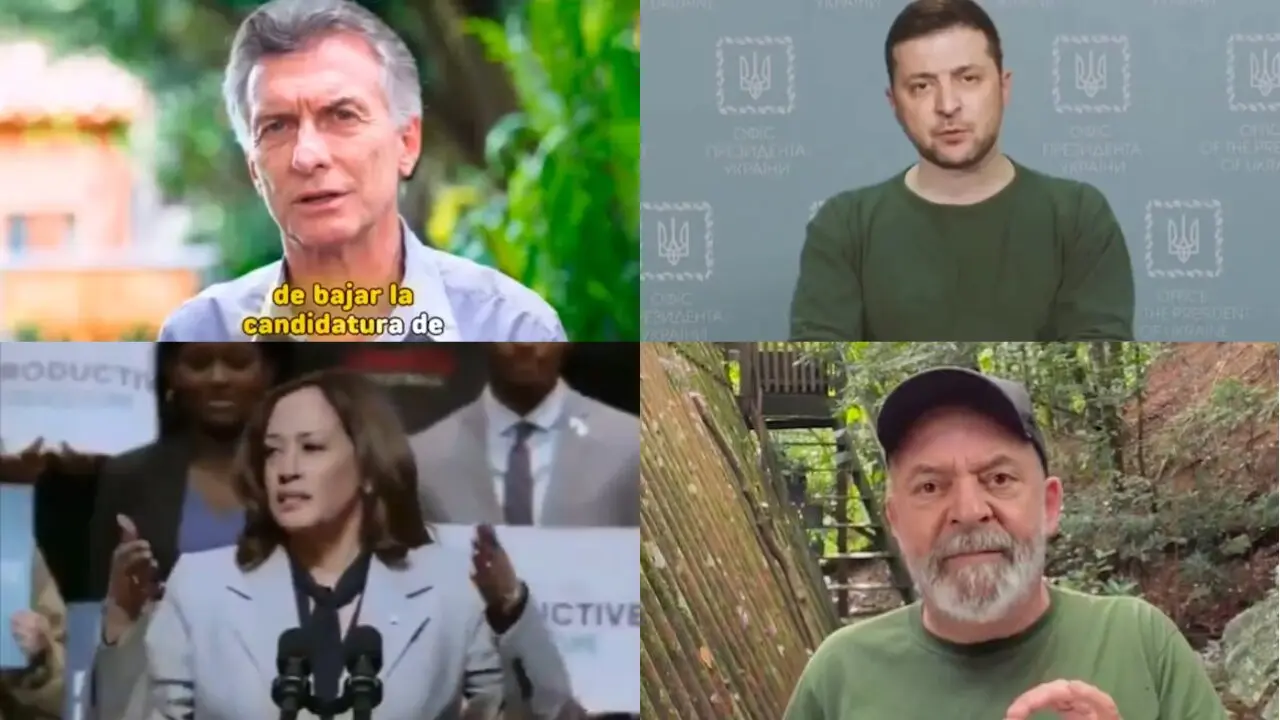

En 2024, durante la carrera presidencial en los Estados Unidos que tuvo como principales candidatos a Donald Trump (Partido Republicano) y Kamala Harris (Partido Democráta), partidarios de Trump utilizaron la IA para mostrarlo en situaciones heroicas, mientras que sus detractores usaron imágenes manipuladas para vincularlo con el empresario Jeffrey Epstein o conspirar sobre el atentado que sufrió durante un mitin.

Algo similar pasó en el contexto de las elecciones presidenciales de 2022 en Brasil, donde se viralizaron varios “deepfakes” -videos generados sintéticamente con tecnología basada en inteligencia artificial con el objetivo de crear secuencias falsas pero realista- sobre los candidatos Lula da Silva y Jair Bolsonaro.

En marzo de 2022 también circuló un video donde el presidente de Ucrania, Volodímir Zelenski, supuestamente le pedía a sus tropas que se rindieran y dejaran las armas ante el ejército ruso. Se trató de un deepfake que el propio mandatario desmintió a través de su perfil de Instagram.

¿Cómo identificar si un video fue generado con IA?

La inteligencia artificial evoluciona día a día y es cada vez más complejo detectar si un video ha sido creado con esta tecnología. No obstante, existen algunos elementos a los que podemos estar atentos para evitar caer ante contenidos que buscan desinformar.

1. El diablo está en los detalles

Para saber si un video fue creado con inteligencia artificial se recomienda afinar el ojo y buscar detalles. Generalmente, los vídeos creados por IA suelen tener muy pocos detalles o los fondos aparecen difuminados.

El MIT Media Lab, el laboratorio de la Escuela de Arquitectura y Planificación del Instituto de Tecnología de Massachusetts, aconseja prestar atención a la cara de quien aparece en la grabación y hacerse algunas preguntas: “¿La piel se ve demasiado lisa o demasiado arrugada? ¿El envejecimiento de la piel es similar al del cabello y los ojos?”.

También es útil fijarse fijarse en los ojos y las cejas (¿aparecen sombras en lugares donde esperarías?), así como en los anteojos y la iluminación (¿hay algún deslumbramiento? ¿Hay demasiado deslumbramiento? ¿Cambia el ángulo del deslumbramiento cuando la persona se mueve?).

Otros detalles a los que podemos prestar atención son el vello facial o la falta del mismo, a los lunares faciales (¿parecen reales?), al parpadeo (¿parpadea la persona lo suficiente o demasiado?) y a los movimientos de los labios (¿se ven naturales? ¿Están sincronizados con la voz?).

2. Volver a las fuentes

Si nos encontramos con un video cuya autenticidad genera dudas, un buen primer paso es buscar su fuente original. Es aconsejable hacer una búsqueda inversa del contenido para encontrar si algún sitio legítimo publicó más información sobre ese video que pueda ayudar a encontrar su origen.

3. Chequear las cuentas de los involucrados

En línea con el consejo anterior, otra recomendación es chequear si hay registros del contenido que circula en las cuentas o canales oficiales de las figuras involucradas.

En el caso de los videos falsos de Mauricio Macri y Silvia Lospennato generados con IA que circularon durante las elecciones legislativas, ambos políticos del PRO habían desmentido rápidamente los contenidos.

4. Observar el ecosistema digital

Es importante identificar quiénes son las cuentas que están difundiendo en redes sociales estos videos generados con IA, con qué sentido y si repiten los copies en sus mensajes.

5. La lectura crítica no pasa de moda

La desinformación puede tomar distintos formatos, pero algo que siempre tiene en común es que apela a nuestros sentimientos o emociones más que a nuestra razón. Tener cuidado cuando aparecen videos con mensajes de este tipo es otro consejo útil.

Por otro lado, cada vez existen más aplicaciones web que permiten verificar, con mayor o menor grado de precisión, si un contenido es real, ha sido manipulado o directamente es falso, tal como señala el sitio de verificación de datos Newtral.

Entre las empresas que ofrecen soluciones para detectar si un contenido es falso o no encontramos: Sensity y RealityDefender, ambas de pago. Entre las accesibles y gratuitas están DeepfakeProof, de DuckduckGoose, que funciona como un plugin de Google Chrome, o Deepware.

Actualización 27/06/2025: esta nota se actualizó con el video hecho con IA sobre Martín Llaryora difundido por Rodrigo De Loredo.

Fecha de publicación original: 20/05/2025

Comentarios

Valoramos mucho la opinión de nuestra comunidad de lectores y siempre estamos a favor del debate y del intercambio. Por eso es importante para nosotros generar un espacio de respeto y cuidado, por lo que por favor tené en cuenta que no publicaremos comentarios con insultos, agresiones o mensajes de odio, desinformaciones que pudieran resultar peligrosas para otros, información personal, o promoción o venta de productos.

Muchas gracias